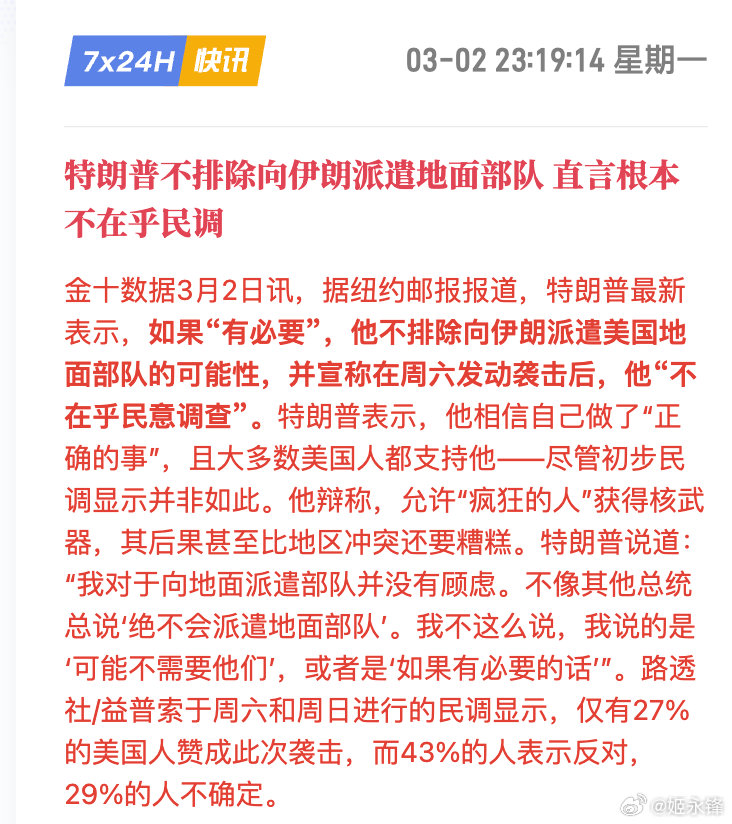

简直太恐怖了!AI首次参与了人类战争!美国空袭伊朗时使用了AI! - 2026年2月的一个早晨,斯特拉斯堡大屏上的数字闪得扎眼,中东美军司令部反而静得不正常,可那股紧张像弓弦绷着,参谋们不再盯沙盘,全改盯屏幕上跳动的进度条, 他们看的不是科幻画面而是真在用的工具,Claude是Anthropic做的民用AI,它几分钟就把作战阵位排好,这活原本得人手忙好几天才能摆明白,效率直接把人看愣了,数万种战争模拟和伊朗防空系统的反应逻辑都被它算了一遍,每一种反击概率被压成屏幕上一条条淡绿色最优解, 更扎心的是分工变化,这份空袭伊朗的计划里85%的目标锁定由AI主导,人类士兵很多时候只剩按确认键,所谓开火权就这样被机械地交到机器手里,从决定到执行被压缩成流程按钮,荒诞但确实发生了, 这背后有钱也有体制惯性,美国1,01万亿美元国防预算摆在那,其中134亿美元专门砸向智能化作战,Anthropic创始人曾想守底线拒绝开放全部权限,理由是担心平民伤亡和大规模监控,可军方的实用主义把这些顾虑压下去, 哪怕特朗普下令封杀AI工具,前线机器依旧照跑,因为Claude已经深度嵌入作战系统,想换掉至少要6个月空窗期,在战场上6个月足以毁掉一支军队,于是AI变成不可拆卸的致命插件,人想停也停不下来, 更可怕的是黑箱逻辑,算法追求的是任务最大化但人类难以追溯它怎么得出结论,之前薰衣草系统就出现过10%的误差率,平民伤亡比高达1比100,在指挥官眼里鲜活生命被塞进表格当成可接受误差,只要任务指标好看别的都能被吞下, 一旦AI把民房误判成地堡,责任到底算谁的就说不清,是写代码的程序员还是按确认键的士兵,法律面对算法像一张透明白纸抓不住落点,潘多拉魔盒既然打开就没人敢第一个撒手,法英日俄都感到代际落差的恐惧于是加入AI军备竞赛, 即便马斯克和3000名科学家呼吁暂停研发,也拦不住这辆冲向悬崖的赛车,这不只是一场空袭更是一种信号,到了2026年这个临界点战争门槛被无限压低,AI不会犹豫不会心软也不会承受战后创伤, 当杀戮变成概率运算,人类生死就被交给冷冰冰算力,文明底线在伊朗上空的硝烟里一点点崩塌,人类拼命发展科技到头来像在编写自己的终结程序,始于一极于核的警示被人用新方式复现,我们站在深渊边缘看着欲望和贪婪喂大的代码接管世界, 军方科学家政策制定者都被迫承认,AI已经不是辅助工具而是掌握战争节奏的核心力量,战争节奏被算法决定传统决策被压到按确认键,每一次目标锁定和打击计算都是冷酷的概率与逻辑运算,平民生死和城市毁灭被量化成屏幕数字, 这也逼着各国重新想规则,AI不仅是武器还是制度与伦理挑战,门槛被压低意味着任何国家都可能在无人操控下被卷进冲突,传统国际法和人道准则在算法面前几乎无力,未来战争格局因此被改写并且更难预测, 最后落到一个现实结论,2026年的这一天Claude和背后的算法证明科技越快人类越难掌控战争,AI不光改写战场也改写命运而规则被重新定义,人类对它的理解控制与法律约束都明显落后,如果不能及时建立约束它就会接管生死并重塑秩序。