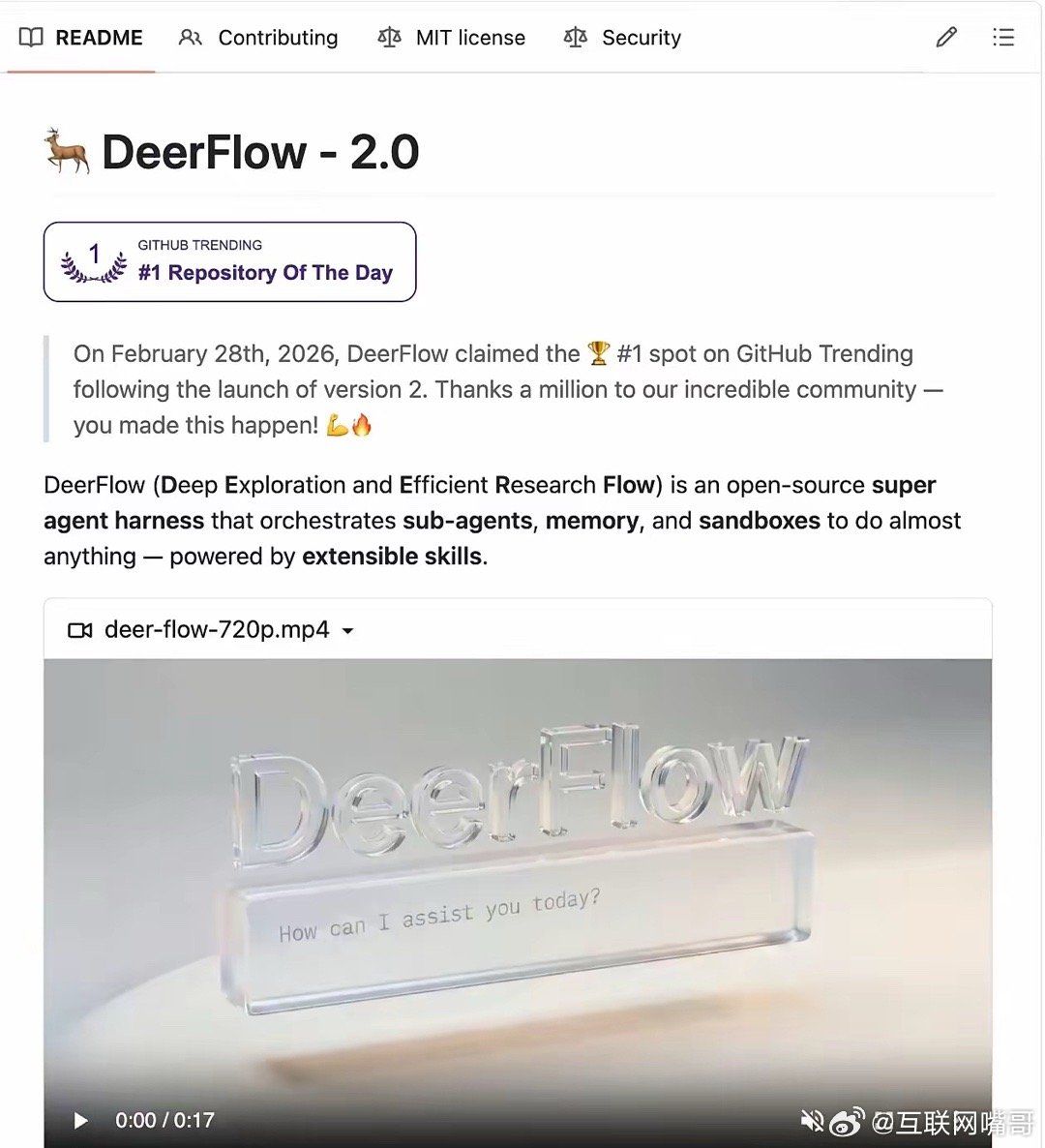

马斯克再次抛出震撼言论,语出惊人!他说:“中国真的被低估了!中国并没有崛起,中国只是恢复了历史地位,自古就是第一强国,他们有很多聪明的头脑,会做出许多伟大的事情,DeepSeek就是其中之一……”可谓是一针见血,振聋发聩! 2025年初DeepSeek R1开源后引发的全球关注,绝非偶然的技术爆发,而是长期积累后的自然显现。这款模型最打动人的地方,在于打破了高端AI的成本神话,用极致的性价比重新定义了行业规则。 DeepSeek R1的核心优势藏在技术架构里,它采用MoE设计,虽然总参数量达到6710亿,但每处理一个Token仅激活370亿参数,这种精准调用让训练成本大幅降低。 整个预训练过程加上后续优化,总共只花费278.8个H800 GPU小时,总成本557.6万美元。对比之下,Meta的Llama 3训练预算约为3930万H100 GPU小时,OpenAI的ChatGPT-4o训练成本更是高达7800万美元甚至1亿美元。 用不到国外同类模型7%的成本,实现了不相上下的性能,这让全球开发者都感到震撼。更关键的是,它的推理成本同样低廉,中小企业甚至个人开发者都能负担,彻底打破了过去AI技术被少数巨头垄断的局面。 开源决策让这种优势进一步放大。DeepSeek没有走国外大模型闭源收费的老路,而是选择向全球开放技术成果,短短两个月内,其GitHub星数就超越了OpenAI,形成了快速增长的开发者生态。 这种模式不仅让更多人受益于AI技术,更通过全球开发者的协作不断优化模型,形成良性循环。 要知道,开源不是简单的代码共享,背后需要强大的技术自信和生态运营能力,而中国在这方面早已打下基础。 华为的昇思MindSpore开源五年,下载量超1300万,覆盖156个国家和地区,社区贡献者超过5.2万,支撑了2500多个学术创新和2000多个行业应用,这种开源生态的成熟度,为DeepSeek的成功提供了重要参照。 能做出这样的技术突破,根源在于扎实的人才储备。全球50%的AI研究人员来自中国,科学家与工程师的总体规模已接近2000万,和G7国家同类人才数量总和相当。 从2015年到2024年,中国AI研究人员数量从不足万人增长到5.2万人,年复合增长率达28.7%,清华大学、北京大学等高校和腾讯、阿里巴巴等企业形成了稳定的人才梯队。 更重要的是,中国每年有上千万普通和职业本专科毕业生进入就业市场,其中大量理工科人才流向AI领域,形成了独特的“工程师红利”。 这种人才规模不是短期堆砌的,而是多年教育投入和产业需求共同作用的结果,为技术创新提供了源源不断的动力。 DeepSeek的爆发也离不开技术积累的厚积薄发。中国AI领域的发展没有走捷径,而是在基础框架、芯片适配、算法优化等方面持续深耕。 像昇思MindSpore打造的HyperParallel架构,专门针对超节点算力环境优化,能充分发挥硬件性能,提升模型训练效率,这种底层技术的突破,让大模型研发少走了很多弯路。 DeepSeek采用的动态注意力机制、多级智能卸载等技术,都是在这些基础积累上的创新应用,既保证了性能,又控制了成本,体现了技术发展的连贯性。 马斯克说中国“恢复历史地位”,精准点出了这种发展的本质。中国自古就有重视技术、勤于钻研的传统,从古代的四大发明到现代的AI创新,这种对技术突破的追求一脉相承。 过去很多人觉得中国AI是“崛起”,其实是忽略了这种长期积累的过程。DeepSeek不是突然出现的技术奇迹,而是无数科研人员、工程师多年深耕的成果,是人才、技术、生态共同作用的必然结果。 这种突破正在改变全球AI的竞争格局。过去国外大模型凭借先发优势,在技术标准、生态构建上占据主导,而DeepSeek用低成本开源的模式,开辟了新的赛道。 它证明了AI技术不一定需要巨额投入,通过架构优化、生态协作,同样能实现高水平突破。这种模式让更多国家和企业能参与到AI创新中,打破了少数国家的技术垄断,也让中国AI的影响力从技术层面延伸到规则层面。 更值得关注的是,DeepSeek的成功不是孤例。随着人才储备的持续增长和技术积累的不断加深,中国在AI领域的创新正在从单点突破走向全面开花。 从基础框架到应用场景,从大模型到边缘计算,形成了完整的产业生态。这种生态化的发展模式,让技术创新更具韧性,也让“恢复历史地位”有了坚实的产业支撑。