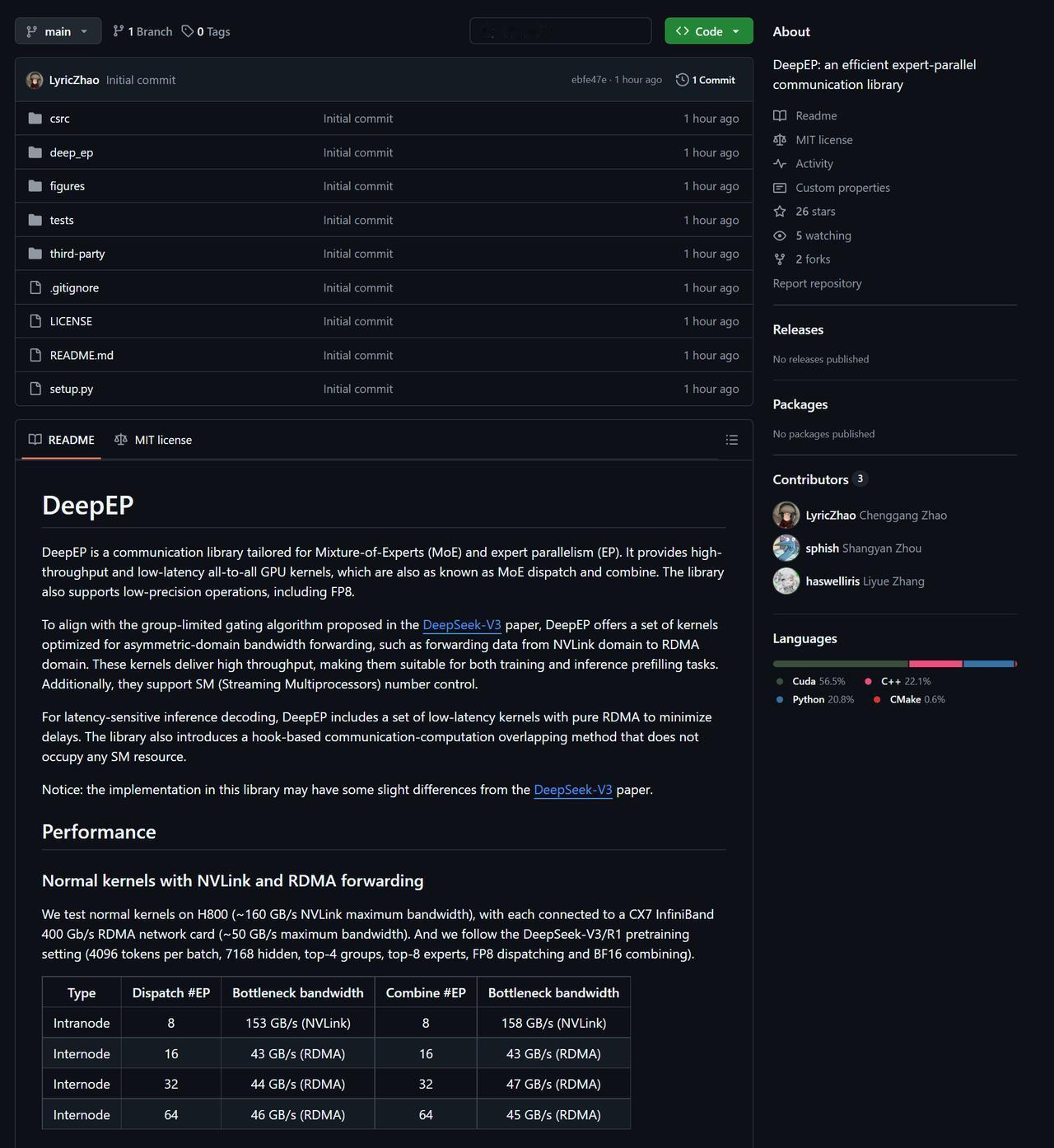

DeepSeek开源第二弹来了 今天DeepSeek开源路DeepEP,这是是一个为**混合专家(MoE)和专家并行(EP)设计的高效通信库,主要用于解决大规模AI模型训练和推理中的数据传输问题。 在大规模模型训练和推理中,Mixture-of-Experts (MoE) 和专家并行(Expert Parallelism, EP)是提升效率的重要技术。然而,通信瓶颈一直是制约性能的关键问题。为此,DeepSeek团队推出了DeepEP,一个专为MoE和专家并行设计的高性能通信库,具备以下亮点: 高吞吐、低延迟的GPU通信 DeepEP提供两种内核: 普通内核:适用于训练和推理的预填充阶段(如数据加载),通过NVLink(GPU内部高速通道)和RDMA(节点间网络)实现全对全通信,带宽可达153 GB/s(NVLink)和46 GB/s(RDMA)。 低延迟内核:专为推理解码设计,采用纯RDMA技术,延迟低至163微秒,且支持通信与计算同时进行(不占用GPU资源)。 低精度计算优化 支持FP8和BF16数据格式,减少内存占用和计算量,提升效率。 说人话,就是这个库分为普通内核,就像高速公路(NVLink)和城市快速路(RDMA)协同运输货物,适合大批量、稳定的运输任务;而低延迟内核:像无人机快递(纯RDMA),直接飞越障碍,适合紧急小件配送(如推理解码)。其中的钩子技术,像交通指挥员,让货车(通信)和私家车(计算)在路口同时通过,不堵车。整体技术能让便宜的算卡发挥超乎想象的能力,让低配的算卡也能快速实现模型的训练和推理能力建设。 天才的想法,真是天才。