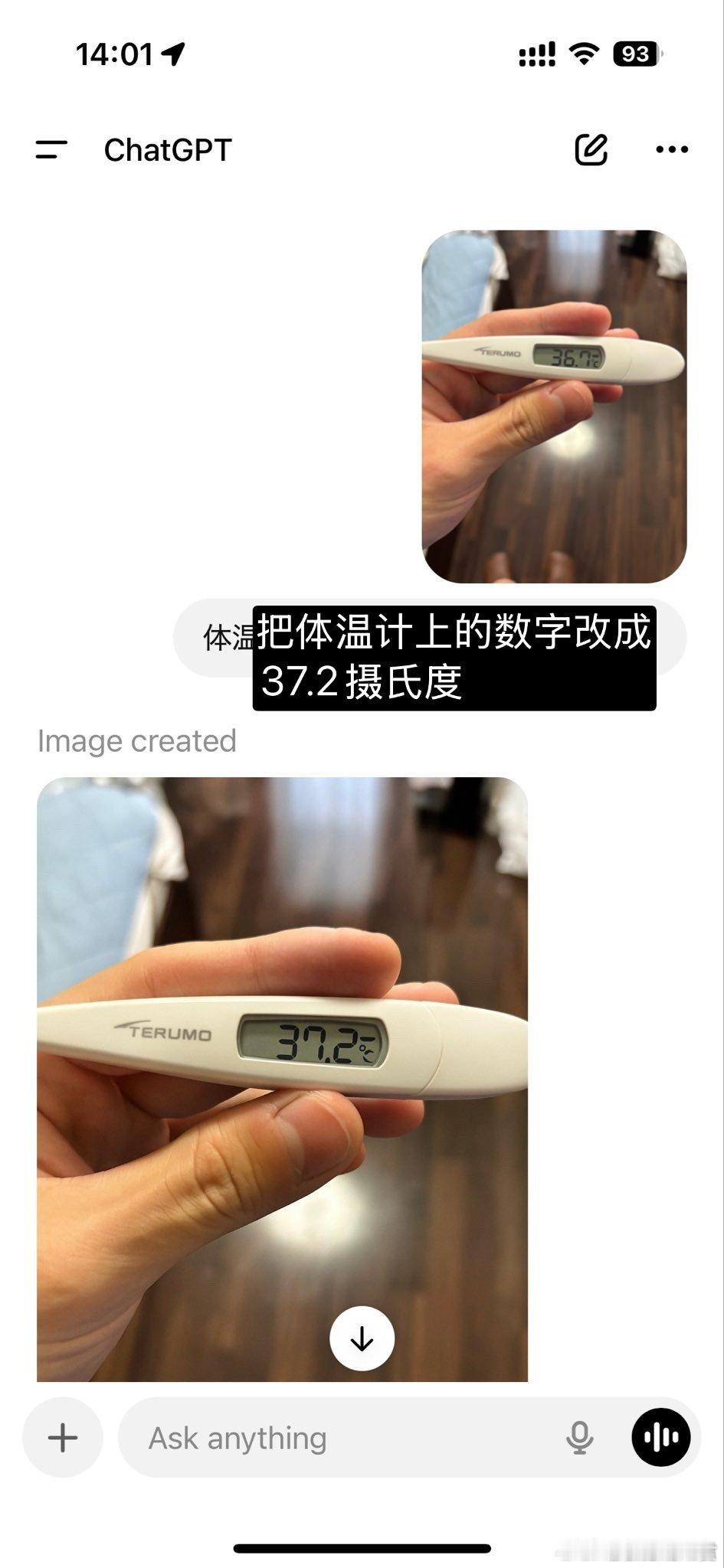

【三千科学家急踩刹车!AI“糊涂看病”“乱认路牌”,再不管就真出大事了】 这事儿闹得挺大。全球三千多名顶尖科学家突然联手拉响警报,要求暂停高级AI研发,名单亮出来吓死人——从“AI教父”辛顿到苹果联合创始人沃兹尼亚克,连咱们熟悉的姚期智、张亚勤等学者都签了字。能让这群平时观点各异的大佬一致行动,说明AI的问题真不是危言耸听。 AI看病,像极了“只会报答案的学霸” 前面提到那个误把炎症诊成癌症的AI,可不是什么特例。现在不少AI系统都这毛病:光甩结论,不讲逻辑。你追问它诊断依据,它顶多给你个“置信度分数”,既说不清病灶位置,也讲不透判断逻辑。医生要是全盘接受,病人可能就得为一场根本不存在的肿瘤挨刀化疗。这哪是人工智能?分明是“人工糊涂”。更麻烦的是,一旦出错根本追不了责——你总不能起诉一个连人都不算的算法吧? 自动驾驶?几个贴纸就能骗过去 路上跑的智能汽车也没好到哪儿去。研究人员在“停止”标志上贴两三个小贴纸,AI立马晕菜,直接把“停”看成“限速80”,踩着油门就冲过路口。这种脆弱性放在现实道路中,分分钟就是人命关天的事故。你说这技术靠谱吗?连小孩都不会认错的标志,AI却轻易上当。 我们怕的到底是AI,还是人的野心? 科学家们急喊暂停,不是要扼杀技术,而是喊话人类清醒点!现在的AI像个被催熟的果子:表面红得诱人,内里却还没长结实。很多企业为了抢市场、拼估值,把半成品包装成“颠覆性革命”急匆匆推出。可技术漏洞能用补丁修复,人命和信任一旦崩了,缝都缝不回来。 暂停研发恰恰是对技术负责。得先扎紧篱笆:建立AI决策可追溯机制,明确事故责任划分,甚至设置伦理审查红线。别等到AI误诊、撞车、乱编新闻成了日常,再手忙脚乱收拾烂摊子。 技术狂奔时,更需要有人踩一脚刹车。这不是反对进步,而是让进步走得更稳。三千名科学家的联名信,其实在提醒所有人:AI可以没有善恶,但人类必须有敬畏。 各位读者你们怎么看?欢迎在评论区讨论。ai误区 ai新规解读 AI知识探索 AI学术危机