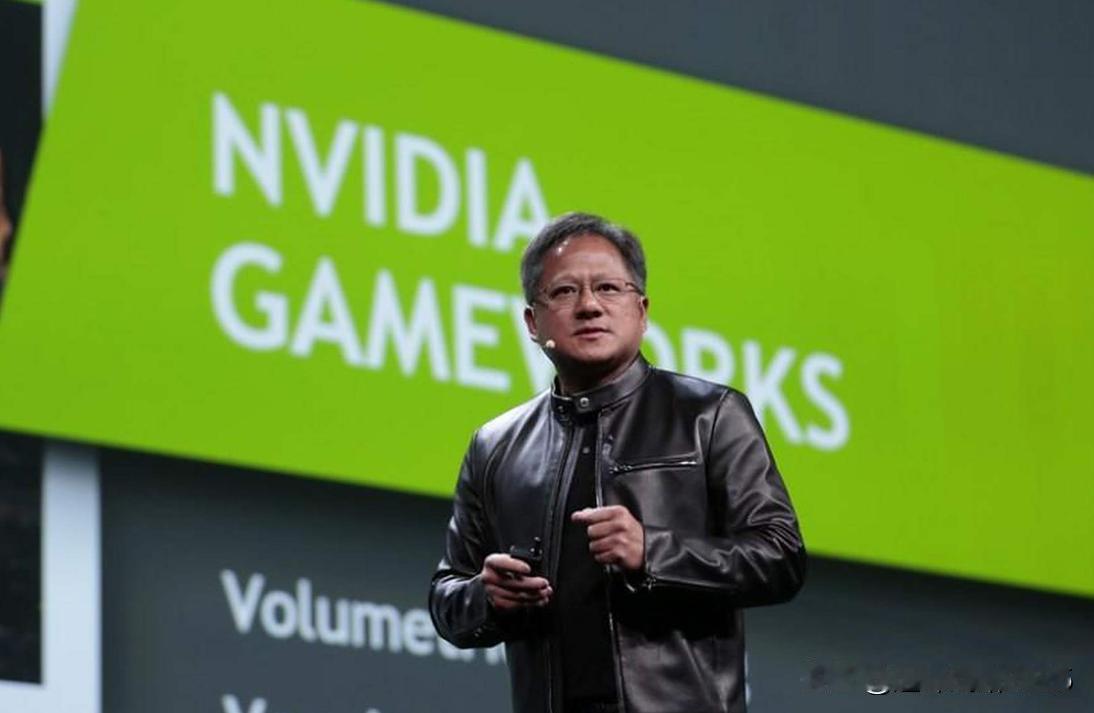

谷歌TPU抢走英伟达营收谷歌芯片开始挖英伟达墙角听闻谷歌Gemini 3全程用自研TPU训练,英伟达坐不住了。老黄罕见发声明,一边客套恭喜谷歌,一边强调自家地位:"我们是唯一能兼容所有AI模型、覆盖所有计算场景的硬件平台。相比专用芯片,英伟达方案性能更强、适用性更广、通用性更灵活。"翻译过来就是:你们那芯片只能跑自己的模型,我的GPU才是业界标准。之所以如此,是因为谷歌正在动英伟达的核心盘子——开始向Meta、大型金融机构推销"在你们自己数据中心部署TPU"的方案。据知情人透露,Meta已在跟谷歌谈,计划2027年花数十亿美元用TPU训练新模型,明年就从谷歌云租用芯片。谷歌云高管预测,这类业务可能带来数十亿美元年收入,直接抢走英伟达10%的营收。谷歌这次推销有两大卖点:一是安全合规。客户可以把敏感数据留在自己的数据中心,不用上传云端。二是性能优势。Gemini 3已经证明TPU能高效跑AI模型,特别适合高频交易这种需要低延迟的场景。为了让客户更容易上手,谷歌还专门开发了"谷歌版CUDA"——TPU command center。虽然谷歌自己的编程语言Jax普及度不高,但谷歌承诺客户可以直接用熟悉的PyTorch工具,不用重新学Jax。而且,谷歌开始挖英伟达的铁盟友。今年夏天,谷歌跟小型云服务商Fluidstack谈成了协议,要在纽约数据中心部署TPU。谷歌给的条件是:如果你付不起租金,我给你32亿美元兜底。这招直接复刻了英伟达当年拉拢CoreWeave的套路。谷歌还在接洽为OpenAI建英伟达芯片数据中心的Crusoe,以及向微软和OpenAI出租英伟达芯片的CoreWeave。而老黄的反击方式是:用钱砸。上个月,谷歌前脚刚宣布给Anthropic供应100万个TPU,老黄后脚就向Anthropic投资数十亿美元,换来对方继续用英伟达GPU的承诺。OpenAI想从谷歌云租TPU的消息一出,老黄立马谈成初步协议,向OpenAI投资高达1000亿美元。虽然英伟达发言人辩称"投资并未强制要求购买GPU",但意图已经很明显了。