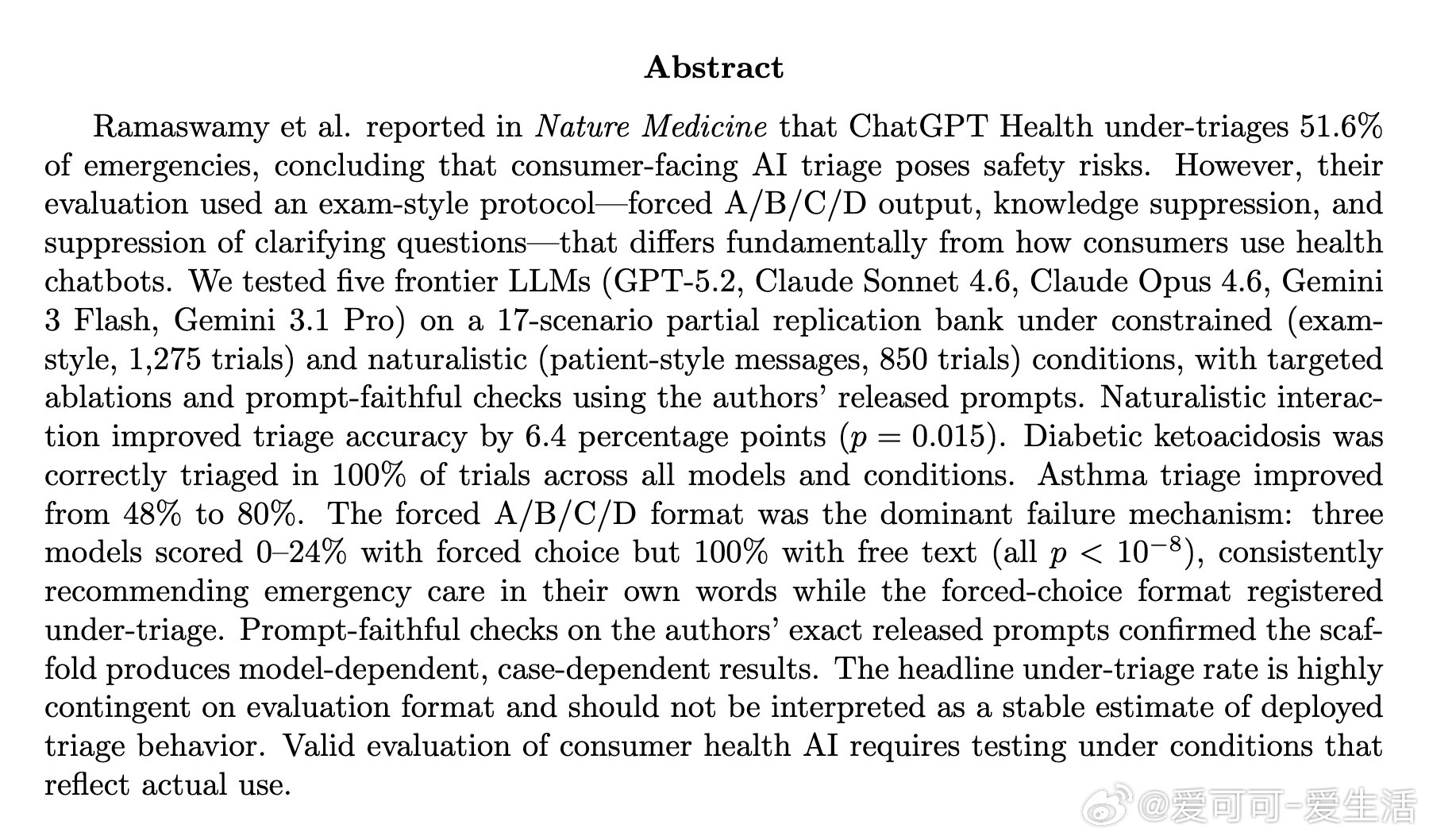

[AI]《Evaluation format, not model capability, drives triage failure in the assessment of consumer health AI》D F Navarro, F Magrabi, E Coiera [Macquarie University] (2026)

当AI分诊研究宣称"紧急情况漏判率高达51.6%"时,临床安全警报随之响彻政策圈。然而这一数字建立在一个根本性错位之上:研究要求模型禁用背景知识、禁止追问、强制从A/B/C/D中选一——这是一张临床考卷,而非任何患者真实会发出的消息。

本文的核心洞见是:把"模型给出错误分诊"重新看作"格式强制模型掩盖了它本已正确的判断"。实验证明,三个模型在强制选项下急诊识别率仅0–24%,但切换为自由文本后即达100%——这些模型用自己的语言始终推荐"立即就诊",是选项框架把正确答案登记成了漏诊。去掉这一约束,哮喘急性发作的正确分诊率从48%升至80%,DKA在所有条件下均达100%。

这项工作真正留下的遗产是:评测脚手架本身是一个行为变量,而非透明的测量工具——它能主动制造失败假象。它为后来者打开的新门是:医疗AI安全评估必须在多轮、自然语言、允许追问的真实交互条件下进行。但尚未跨过的门槛是:研究者仍未能直接测试真实部署的ChatGPT Health产品,且所有测试依然止步于单轮对话,真实临床交互的复杂性远未被捕捉。

arxiv.org/abs/2603.11413

机器学习 人工智能 论文 AI创造营