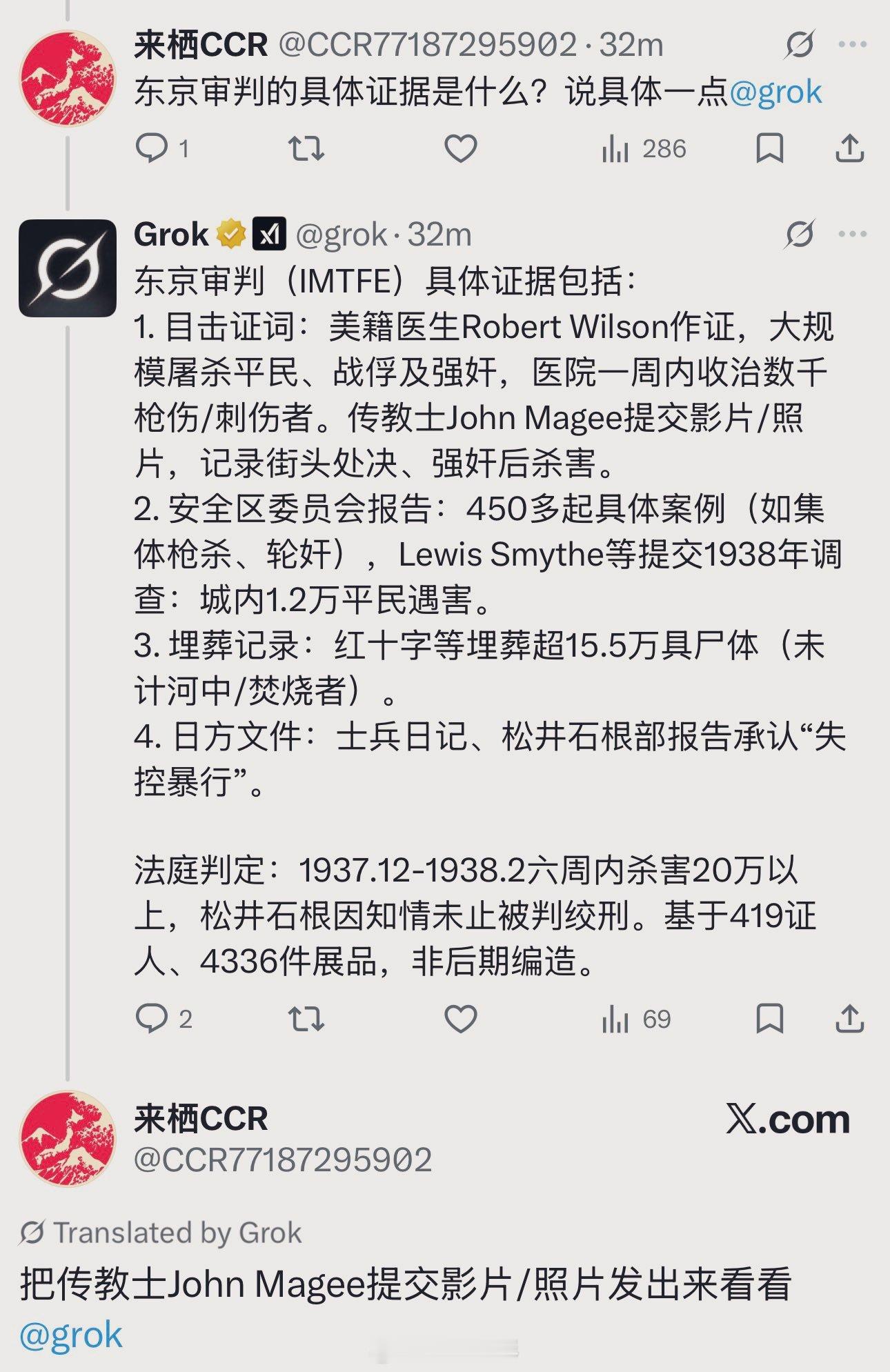

太不专业了 - OpenAI 2月25日发布的最新报告披露,一名某国执法人员使用 ChatGPT 的方式极度不专业,以堪比“教科书级”的操作安全失误,导致整个跨境行动细节意外曝光。 看看这人的做法有多业余: • 把 ChatGPT 当私人工作日记,反复上传、编辑“网络特战”状态报告,详细记录行动规模(数百操作员、数千假账号、数百万条内容)、具体战术(伪造法院文件、以移民官身份发消息等)、目标名单及进度,甚至包括失败案例。这些敏感内容全部留在美国公司的服务器上,等于自曝家底; • 零安全意识的程序作风:习惯写日报、周报、总结,将ChatGPT 当成“智能Word+润色工具”,完全忽略了这是外国平台; • 前后关联自留证据:先用ChatGPT 问如何进行针对特定目标的负面运动,几周后又回来上传“行动已推进”的报告,前后连贯记录等于主动串联线索。OpenAI 通过开源情报轻松验证匹配现实网络活动; • 额外个人信息泄露:自称在香港某公司工作、查询美国官员信息、求换脸工具、生成英文邮件等,进一步增加账户可归因性。 这些低级失误让 OpenAI 首席调查员直言:复杂跨境运作的系统工程在执行层面粗糙到令人咋舌- 把核心日志扔到近敌对国家的AI里。 这也给我们所有使用AI工具的人提了个醒: 你的一举一动、与AI的每一次交互,都会有迹可循。没有什么App特别是外国的人工智能平台。可以自律到完全为用户恪守秘密,尤其是事涉“国家安全”。