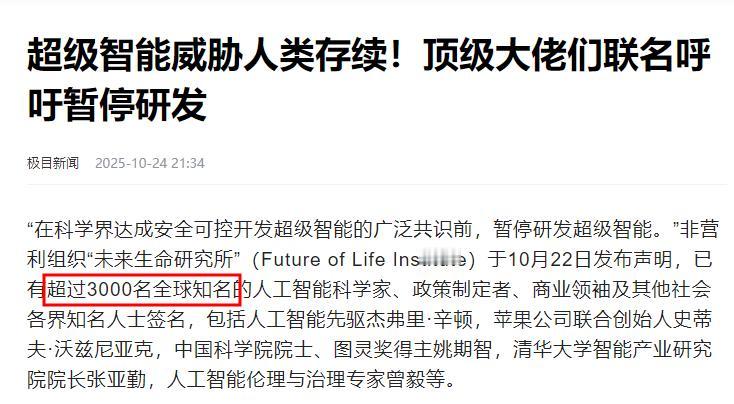

被这两天的新闻吓到了!你们知道吗?全球超过3000名顶尖科学家和科技大佬突然联名发出紧急呼吁,要求立刻暂停高级人工智能的研发! 这场声势浩大的行动,由苹果联合创始人沃兹尼亚克、人工智能教父杰弗里·辛顿牵头,背后是未来生命研究所(FLI)在10月22日正式抛出的联名倡议,短短一天时间,签名人数就从最初的800多人飙升至3000人,后续甚至可能突破五千大关,把2023年马斯克牵头的那封千人群发信衬得像场小型茶话会。 能让这群平时忙着争夺专利、抢占赛道的大佬们放下恩怨抱团,显然不是闹着玩的,签名名单堪称跨界缝合怪,科技圈有维珍老板布兰森撑场,政界坐着前美国国家安全顾问苏珊·赖斯、前参谋长联席会议主席迈克·马伦,连英国王妃梅根和特朗普盟友班农这种政治光谱两极的人物都能同框,这种跨越立场的共识,比AI写出押韵诗还罕见,中国学界也没缺席,姚期智院士、清华的张亚勤和薛澜这些平时埋首实验室的专家,这次也站出来签了名,刚好呼应了国内一直强调的"安全可控"AI理念。 要搞明白这事儿的分量,得先看清他们喊停的到底是什么,倡议里明确定义了目标——牛津哲学家口中"几乎所有领域都超过最聪明人"的超级智能,可不是咱们手机里帮着写文案的应用型AI。 说白了,就是那些已经开始显现不可预测性的顶尖模型,毕竟现在连训练它们的工程师,都未必能说清某些决策是怎么来的,2023年喊停6个月的呼吁还带着试探,这次直接把可控、安全、公众支持列为重启前提,显然是有人摸到了技术的危险边界。 而大佬们的焦虑不是空穴来风,民调早给出了答案,七成美国人想给先进AI套上更紧的监管枷锁,六成觉得没做好安全措施前别瞎折腾。 而且,现在风险也确实摆在台面上:经济上,自动化已经盯着客服、基础文案这些岗位磨刀;伦理上,隐私被算法扒得底朝天不是新鲜事;更让人头皮发麻的是"存在性风险",有历史学者直言这可能击垮人类文明的底层逻辑,更讽刺的是过去四年AI核心专利年增47%,可研究安全控制的专利只涨了15%,就像拼命给房子添家具,却懒得装防盗门。 其实这事早有苗头,从2015年第一封学术腔的呼吁信,到2023年的千人联名,再到这次带着具体方案,比如建全球AI署、设"红色团队"找漏洞的倡议,大佬们的抗议已经从喊口号进化成递方案了,但尴尬的是这边签名墙还在加长,那边实验室的训练机没停过,毕竟资本催着出成果,谁也不愿做第一个掉队的冤大头。 说到底,这3000多个签名更像一次集体预警,不是要砸掉AI的饭碗,而是逼着行业和监管者正视"规则跑不过技术"的现实,那些嘲讽大佬杞人忧天的人,不妨看看数据,AI专利增速是安全研究的三倍,就像开车只踩油门不看刹车,出事是早晚的事。 当然,想搞出类似核不扩散的全球公约难度不小,各国都有自己的小算盘,但至少这场呼吁把问题从实验室拽到了饭桌,让普通人也明白AI不是只用来追剧的玩具。 至于能不能真的按住技术狂奔的脚步?大概率是"边喊停边往前挪"的拉锯战,但至少这次,那些最懂AI的人把危险两个字刻在了明面上,比起闷头狂奔到翻车,这种带着焦虑的刹车声,反而是件好事。